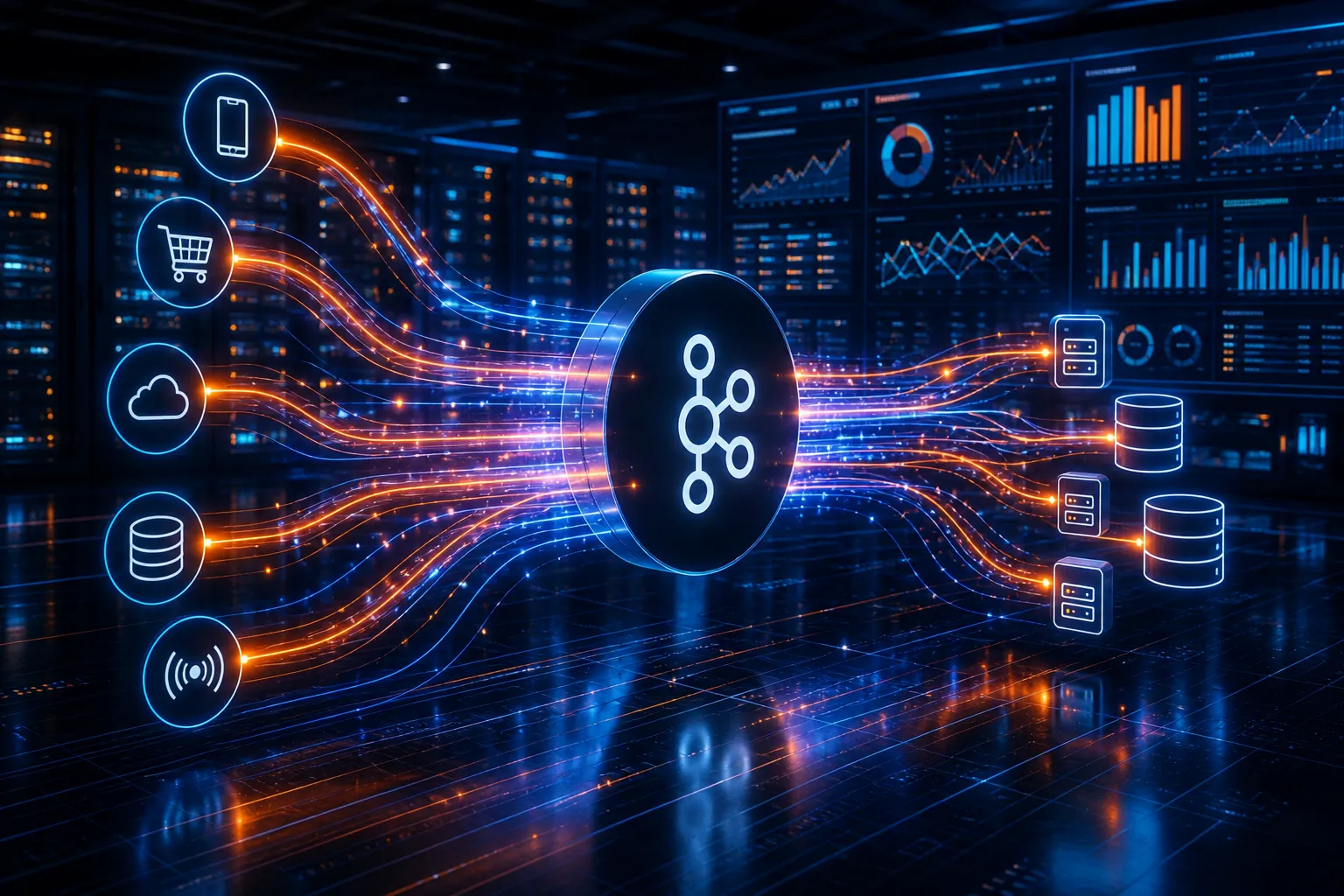

Hasta hoy muchas aplicaciones empresariales fueron construidas bajo arquitecturas monolíticas y procesos síncronos donde cada sistema dependía directamente de otro para funcionar. Este modelo funcionó durante mucho tiempo, pero comenzó a mostrar limitaciones cuando las organizaciones necesitaron procesar grandes volúmenes de información en tiempo real, integrar múltiples plataformas y escalar servicios de forma independiente.

Aquí es donde las arquitecturas event-driven comenzaron a ganar protagonismo. Una arquitectura orientada a eventos permite que los sistemas reaccionen a cambios o acciones en tiempo real mediante la publicación y consumo de eventos. En este contexto, herramientas como Apache Kafka se han convertido en uno de los componentes más utilizados para construir ecosistemas de datos modernos, resilientes y altamente escalables.

Sin embargo, implementar Kafka sin una estrategia clara de integración con bases de datos puede generar más complejidad que beneficios. Diseñar correctamente la relación entre eventos y persistencia es lo que realmente define el éxito de una arquitectura event-driven.

¿Qué es una arquitectura event-driven?

Una arquitectura event-driven se basa en la generación, transmisión y procesamiento de eventos. Un evento representa un cambio de estado dentro de un sistema:

- Un pedido creado

- Un pago aprobado

- Una sesión iniciada

- Una actualización de inventario

En lugar de que los sistemas se comuniquen de forma directa y síncrona, los eventos se publican en un broker como Kafka y otros servicios los consumen cuando lo necesitan.

Esto permite:

- Desacoplar aplicaciones

- Escalar servicios independientemente

- Procesar datos en tiempo real

- Reducir dependencias rígidas

La base de datos deja de ser únicamente un repositorio pasivo y se convierte en parte activa del flujo de eventos.

El rol de Kafka dentro de la arquitectura

Apache Kafka funciona como un sistema distribuido de streaming de eventos. Su objetivo es recibir, almacenar y distribuir eventos de manera eficiente y tolerante a fallos.

Kafka permite:

- Manejar millones de eventos por segundo

- Distribuir información entre múltiples consumidores

- Garantizar persistencia de eventos

- Reprocesar información histórica

Gracias a esto, Kafka se ha convertido en una pieza central en arquitecturas modernas basadas en microservicios y procesamiento en tiempo real. Sin embargo, Kafka no reemplaza una base de datos. La complementa.

Cómo integrar Kafka con bases de datos correctamente

Uno de los errores más comunes es pensar que Kafka puede sustituir completamente el almacenamiento persistente tradicional. En realidad, las bases de datos siguen siendo esenciales para:

- Consultas complejas

- Consistencia transaccional

- Reporting

- Almacenamiento estructurado

- Integridad de negocio

La clave está en diseñar una arquitectura donde Kafka y la base de datos trabajen juntos. Existen varios enfoques comunes:

1. Change Data Capture (CDC)

Herramientas como Debezium permiten capturar cambios directamente desde la base de datos y convertirlos en eventos dentro de Kafka. Esto permite sincronizar sistemas en tiempo real sin afectar aplicaciones existentes.

2. Event sourcing

En este modelo, los eventos se convierten en la fuente principal de verdad. La base de datos reconstruye el estado a partir del historial de eventos almacenados. Aunque poderoso, este enfoque requiere diseño avanzado y gobernanza estricta.

3. Kafka como integración entre microservicios

Cada servicio mantiene su propia base de datos y utiliza Kafka para compartir eventos con otros servicios. Este modelo reduce dependencias y mejora escalabilidad.

Mejores prácticas al diseñar arquitecturas event-driven

Diseñar eventos claros y desacoplados

Los eventos deben representar acciones de negocio concretas y evitar dependencias innecesarias entre sistemas.

No sobrecargar Kafka con lógica de negocio

Kafka debe transportar eventos, no convertirse en el centro de toda la lógica operativa.

Garantizar idempotencia

Los consumidores deben poder procesar eventos repetidos sin generar inconsistencias.

Monitorear continuamente el flujo de eventos

Métricas clave incluyen:

- lag de consumidores

- throughput

- latencia

- fallos de procesamiento

Ventajas reales de una arquitectura event-driven

Cuando se implementa correctamente, este modelo ofrece beneficios importantes:

- Procesamiento en tiempo real

- Escalabilidad horizontal

- Desacoplamiento entre sistemas

- Resiliencia ante fallos

- Integración eficiente entre plataformas

Además, permite construir sistemas preparados para inteligencia artificial, analítica avanzada y procesamiento masivo de datos.

Muchas organizaciones implementan Kafka esperando resolver automáticamente sus problemas de integración y escalabilidad. Pero Kafka por sí solo no garantiza una buena arquitectura. El verdadero desafío está en diseñar correctamente:

- El flujo de eventos

- La persistencia de datos

- La gobernanza

- La observabilidad

- La integración entre sistemas

En DBA Experts trabajamos constantemente en arquitecturas modernas de datos, ayudando a organizaciones a construir ecosistemas escalables, resilientes y preparados para el futuro.

Te invitamos a:

🔹 Conectar con nosotros en LinkedIn

🔹 Explorar más artículos técnicos en nuestro blog

🔹 Descubrir cómo optimizar arquitecturas de datos modernas con Kafka y bases de datos empresariales

Porque los datos ya no solo se almacenan. Ahora fluyen en tiempo real.